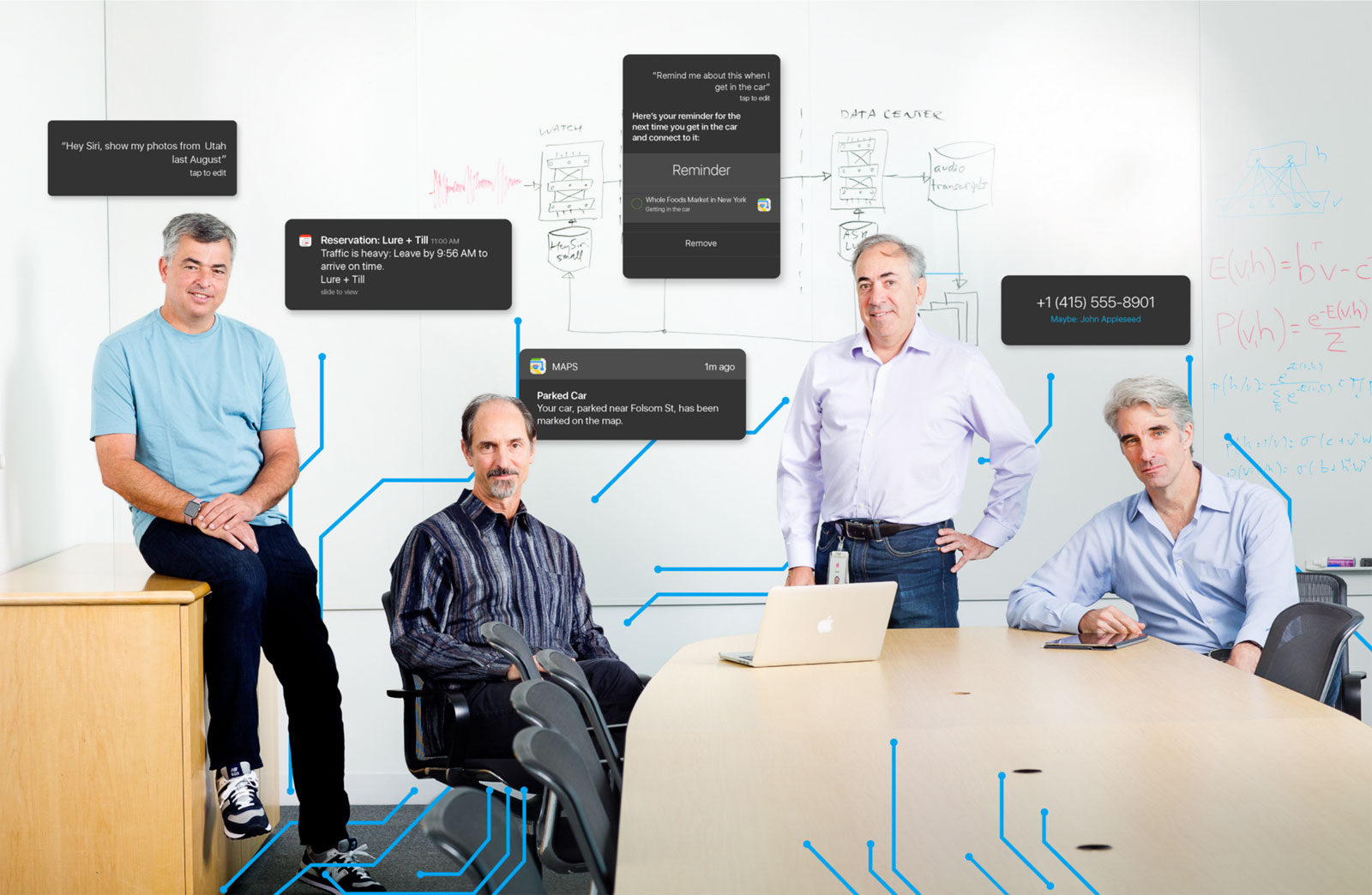

En una entrevista que Apple ha concedido a Steven Levy con Eddy Cue, Phil Schiler, Craig Federighi y dos especialistas del equipo de Siri, se han podido saber muchos detalles interesantes acerca de cómo funciona Siri, el asistente virtual de iOS. Por ejemplo, sabemos que las mejoras en entendimiento y respuestas que Siri ha mostrado en los últimos años se deben a un cambio en el sistema de servidores que le dan vida, que ha pasado a ser una red neuronal desde el año 2014, confirmando el rumor que apareció precisamente por esa época.

Según cuenta uno de los dos especialistas de Apple, Alex Acero, que lidera el equipo de síntesis de voz de Siri, la tasa de error del asistente se ha reducido a la mitad en muchos idiomas, o incluso más en muchos casos, gracias a la manera en la que lo han optimizado y los sistemas de aprendizaje que han implementado. Para conseguirlo, han recurrido a uno de los puntos fuertes de Apple; tanto el hardware como el software están construidos por la misma empresa.

Acero ha estado trabajando junto a los equipos que diseñan el hardware o se encargan de posicionar micrófonos para que la experiencia sea óptima, y luego ha optimizado el software que hace funcionar a Siri para ese mismo hardware, consiguiendo una integración que muchos fabricantes de smartphones Android no pueden obtener, ya que ellos no desarrollan el software y se limitan a seguir directrices de Google.

La entrevista se centra sobre todo en los desarrollos que Apple está haciendo en torno al aprendizaje artificial utilizando datos de utilización anónimos del usuario. Siri obviamente depende mucho de este tipo de tecnología pero en iOS la tenemos y utilizamos todos los días casi sin darnos cuenta. Es gracias a este tipo de aprendizaje, por ejemplo, que podemos elegir la palabra correcta sugerida en el autocorrector del teclado virtual, y también gracias a este aprendizaje podemos tener recomendaciones de Apple basadas en la utilización que hacemos el iPhone con el paso del tiempo… o incluso el sistema que permite reconocer una cara a la hora de hacer una foto y enfocar ahí automáticamente. Todo esto se lo debemos a las redes neuronales de Apple y la red de servidores que ofrecen los servicios sobre los que funciona iOS.

Parte del proceso de datos que se utiliza para dar vida a todas estas funciones avanzadas de iOS, a menudo, se produce en el propio iPhone o iPad, utilizando la enorme potencia de los procesadores actuales. Los directivos de Apple nos cuentan en esta entrevista que han sabido encontrar el punto medio entre la obteción de datos necesaria para poder hacer funcionar sus servicios avanzados y la protección de la privacidad de sus usuarios.

Si te interesa aprender más sobre los esfuerzos de Apple en esto de la Inteligencia Artificial o sobre redes neuronales, puedes leer la entrevista completa de Levy aquí. Realmente merece la pena si tienes especial interés en saber cómo se consiguen hacer funcionar cosas tan complejas como Siri.