Un equipo de varias personas en Apple de las que sólo una parece no tener origen chino ha publicado un paper en el que describen un nuevo juego de datos utilizado para hacer funcionar un modelo de edición de imagen guiado a través de texto. Si el argot de la inteligencia artificial te parece difícil de entender, básicamente se trata de un método mejorado para conseguir editar una imagen pidiéndole cosas mediante texto escrito, como pueden hacer ahora muchos modelos como Gemini. Se llama Pico-Banana-400K.

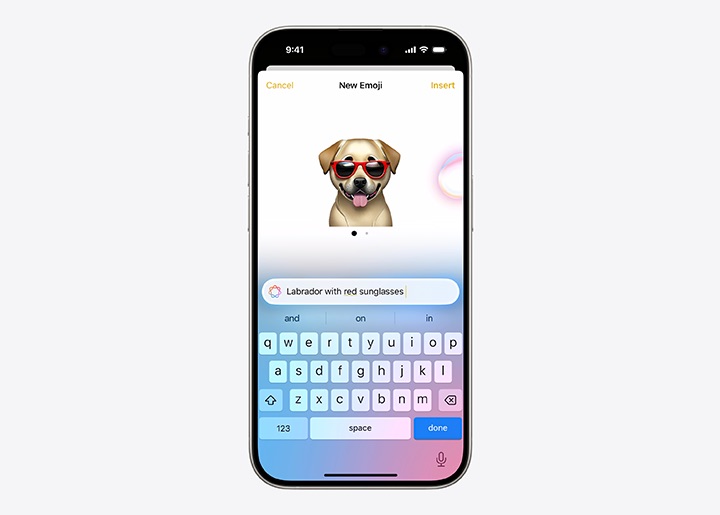

Datos que mejoran entrenamientos de modelos generativos como éste podría ser útil en futuras versiones de servicios como Genmoji y otros, o Magic Wand, para pedir a Apple Intelligence que quite algo o alguien que nos molesta de una imagen generando también lo que se supone que podría haber detrás de ese objeto o persona. El estudio llega tras los últimos avances de GPT-4o de OpenAI y de Nano-Banana por el lado de Google a la hora de editar imágenes desde chatbots como ChatGPT o Gemini, respectivamente.

Por ahora Apple no ha indicado en ningún momento que algo como esto se vaya a utilizar en ninguno de los modelos de Apple Intelligence pero que un equipo de desarrolladores de IA en Apple publique el estudio indica que hacen sus investigaciones y pruebas, así que, por supuesto, que esto pueda acabar funcionando en un producto de Apple no sería una sorpresa.

Apple indica que los modelos de la competencia no están entrenados correctamente por el juego de datos que han utilizado, y que este nuevo paquete de datos que ellos ofrecen mejora los resultados, con grupos de imágenes preparados para 35 tipos de ediciones diferentes en ocho categorías, cubriendo desde cambios de color a la eliminación de objetos o la generación de paisajes, entre muchos otros. Luego utilizan Gemini 2.5 Pro (Nano-Banana) para probar las mejoras. por eso el nombre de Pico-Banana-400K.

Estaría bien dejar de ver papers y ver todo esto funcionando en un iPhone sin tener que esperar demasiado tiempo.